Nächste Seite: PERFORMANZMASS

Aufwärts: ARCHITEKTUR UND NETZWERKDYNAMIK

Vorherige Seite: ARCHITEKTUR 1

Inhalt

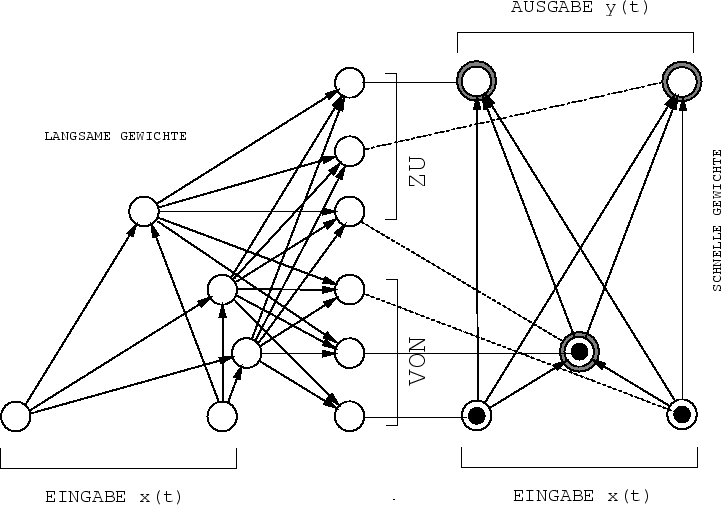

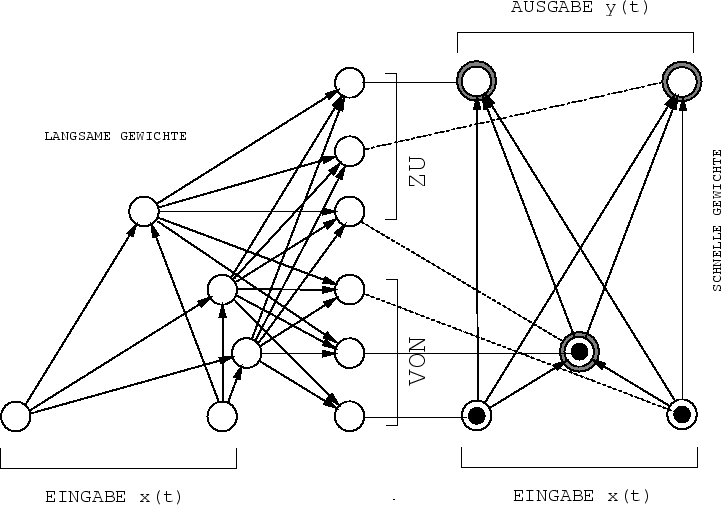

Stelle für jeden Knoten in  , dem wenigstens eine Verbindung

mit einem schnellen Gewicht entspringt, einen Ausgabeknoten in

, dem wenigstens eine Verbindung

mit einem schnellen Gewicht entspringt, einen Ausgabeknoten in  bereit.

Nenne die Menge derartiger Ausgabeknoten VON.

Spendiere

einen weiteren

Ausgabeknoten in

bereit.

Nenne die Menge derartiger Ausgabeknoten VON.

Spendiere

einen weiteren

Ausgabeknoten in  für jeden Knoten in

für jeden Knoten in  , zu dem wenigstens eine

`schnellgewichtige' Verbindung führt.

Nenne die Menge dieser Ausgabeknoten ZU.

Für jede Gewichtsvariable

, zu dem wenigstens eine

`schnellgewichtige' Verbindung führt.

Nenne die Menge dieser Ausgabeknoten ZU.

Für jede Gewichtsvariable

haben wir jetzt

einen Knoten

haben wir jetzt

einen Knoten

VON und einen Knoten

VON und einen Knoten

ZU. Definiere für den Zeitpunkt

ZU. Definiere für den Zeitpunkt

wobei  bezüglich all seiner Parameter

differenzierbar sein muß.

Wir konzentrieren uns auf ein repräsentatives Beispiel, nämlich

den Fall, daß

bezüglich all seiner Parameter

differenzierbar sein muß.

Wir konzentrieren uns auf ein repräsentatives Beispiel, nämlich

den Fall, daß

den Multiplikationsoperator darstellt:

den Multiplikationsoperator darstellt:

|

(3.5) |

Dies bedeutet, daß  's schnelle Gewichte von

's schnelle Gewichte von  in Hebb-ähnlicher

Manier [33] manipuliert werden.

Mit Architektur 2 benötigt

in Hebb-ähnlicher

Manier [33] manipuliert werden.

Mit Architektur 2 benötigt  weniger als doppelt so

viele Ausgabeknoten, als Knoten in

weniger als doppelt so

viele Ausgabeknoten, als Knoten in  vorhanden sind.

Siehe Abbildung 3.2.

vorhanden sind.

Siehe Abbildung 3.2.

Abbildung:

Gewichtsänderungen des `schnellen' Netzwerkes

ergeben sich durch die vom langsamen Netz in seinen

beiden Ausgabefeldern  (für den `Schlüssel') und

(für den `Schlüssel') und  (für

den Inhalt) vorgeschriebene

Assoziation.

(für

den Inhalt) vorgeschriebene

Assoziation.

|

Man kann sich von der

VON/ZU Architektur folgendes Bild machen:  kreiert befristete Assoziationen, indem es zwei Parameter an

das Kurzzeitgedächtnis weitergibt.

Der erste Parameter ist ein durch VON übermitteltes

Aktivationsmuster, welches den Schlüssel zu einem

temporären Assoziationspaar darstellt, während der

zweite Parameter einen durch ZU übermittelten

Eintrag repräsentiert.

Man beachte, daß sowohl der Schlüssel als auch der Eintrag

versteckte Knoten ansprechen können.

kreiert befristete Assoziationen, indem es zwei Parameter an

das Kurzzeitgedächtnis weitergibt.

Der erste Parameter ist ein durch VON übermitteltes

Aktivationsmuster, welches den Schlüssel zu einem

temporären Assoziationspaar darstellt, während der

zweite Parameter einen durch ZU übermittelten

Eintrag repräsentiert.

Man beachte, daß sowohl der Schlüssel als auch der Eintrag

versteckte Knoten ansprechen können.

Nächste Seite: PERFORMANZMASS

Aufwärts: ARCHITEKTUR UND NETZWERKDYNAMIK

Vorherige Seite: ARCHITEKTUR 1

Inhalt

Juergen Schmidhuber

2003-02-20

Related links in English: Recurrent networks - Fast weights - Subgoal learning - Reinforcement learning and POMDPs - Unsupervised learning and ICA - Metalearning and learning to learn

Deutsche Heimseite

![]() , dem wenigstens eine Verbindung

mit einem schnellen Gewicht entspringt, einen Ausgabeknoten in

, dem wenigstens eine Verbindung

mit einem schnellen Gewicht entspringt, einen Ausgabeknoten in ![]() bereit.

Nenne die Menge derartiger Ausgabeknoten VON.

Spendiere

einen weiteren

Ausgabeknoten in

bereit.

Nenne die Menge derartiger Ausgabeknoten VON.

Spendiere

einen weiteren

Ausgabeknoten in ![]() für jeden Knoten in

für jeden Knoten in ![]() , zu dem wenigstens eine

`schnellgewichtige' Verbindung führt.

Nenne die Menge dieser Ausgabeknoten ZU.

Für jede Gewichtsvariable

, zu dem wenigstens eine

`schnellgewichtige' Verbindung führt.

Nenne die Menge dieser Ausgabeknoten ZU.

Für jede Gewichtsvariable

![]() haben wir jetzt

einen Knoten

haben wir jetzt

einen Knoten

![]() VON und einen Knoten

VON und einen Knoten

![]() ZU. Definiere für den Zeitpunkt

ZU. Definiere für den Zeitpunkt ![]()

![]() kreiert befristete Assoziationen, indem es zwei Parameter an

das Kurzzeitgedächtnis weitergibt.

Der erste Parameter ist ein durch VON übermitteltes

Aktivationsmuster, welches den Schlüssel zu einem

temporären Assoziationspaar darstellt, während der

zweite Parameter einen durch ZU übermittelten

Eintrag repräsentiert.

Man beachte, daß sowohl der Schlüssel als auch der Eintrag

versteckte Knoten ansprechen können.

kreiert befristete Assoziationen, indem es zwei Parameter an

das Kurzzeitgedächtnis weitergibt.

Der erste Parameter ist ein durch VON übermitteltes

Aktivationsmuster, welches den Schlüssel zu einem

temporären Assoziationspaar darstellt, während der

zweite Parameter einen durch ZU übermittelten

Eintrag repräsentiert.

Man beachte, daß sowohl der Schlüssel als auch der Eintrag

versteckte Knoten ansprechen können.