Nächste Seite: PERFORMANZMASS

Aufwärts: ARCHITEKTUR

Vorherige Seite: SUBZIELARCHITEKTUR 1

Inhalt

Ein Nachteil der

Subzielarchitektur 1 besteht darin, daß die Anzahl der

Subziele pro Problem als konstant angenommen wird.

In typischen Umgebungen ist diese Annahme unrealistisch.

Im allgemeinen bräuchte ein System basierend auf

Subzielarchitektur 1 eine ganze Reihe von Subzielgeneratoren:

Einen für Probleme, die nur ein Subziel erfordern, einen

weiteren für Probleme, die zwei Subziele erfordern, und so fort.

Subzielarchitektur 2 hingegen

gestattet ein und demselben Subzielgenerator  , verschieden

lange Sequenzen von Subzielen zu produzieren. Dies wird erreicht,

indem man

, verschieden

lange Sequenzen von Subzielen zu produzieren. Dies wird erreicht,

indem man  ' Ausgabe wie folgt auf die eigene Eingabe rückkoppelt:

' Ausgabe wie folgt auf die eigene Eingabe rückkoppelt:

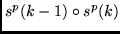

Bei einer gegebenen

durch ein Start/Ziel-Paar

spezifizierten Aufgabe

spezifizierten Aufgabe  ist

ist  ' Eingabevektor

zum 1. Iterationsschritt gleich

' Eingabevektor

zum 1. Iterationsschritt gleich

.

.  ' Ausgabevektor ist

' Ausgabevektor ist  .

.

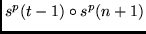

Beim Iterationsschritt

wird

wird  ' Eingabevektor zu

' Eingabevektor zu

, die Ausgabe wird zu

, die Ausgabe wird zu

. Zur Berechnung der Aktivation

. Zur Berechnung der Aktivation  des

des

-ten Nichteingabeknotens in

-ten Nichteingabeknotens in  zum Iterationsschritt

zum Iterationsschritt  schreiben wir

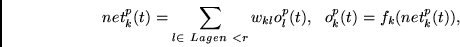

schreiben wir

|

(4.7) |

wobei  wie üblich eine differenzierbare Aktivierungsfunktion

darstellt.

wie üblich eine differenzierbare Aktivierungsfunktion

darstellt.

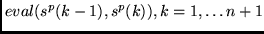

Wieder verwenden wir das Evaluatormodul  zur Berechnung von

zur Berechnung von

, aus

, aus

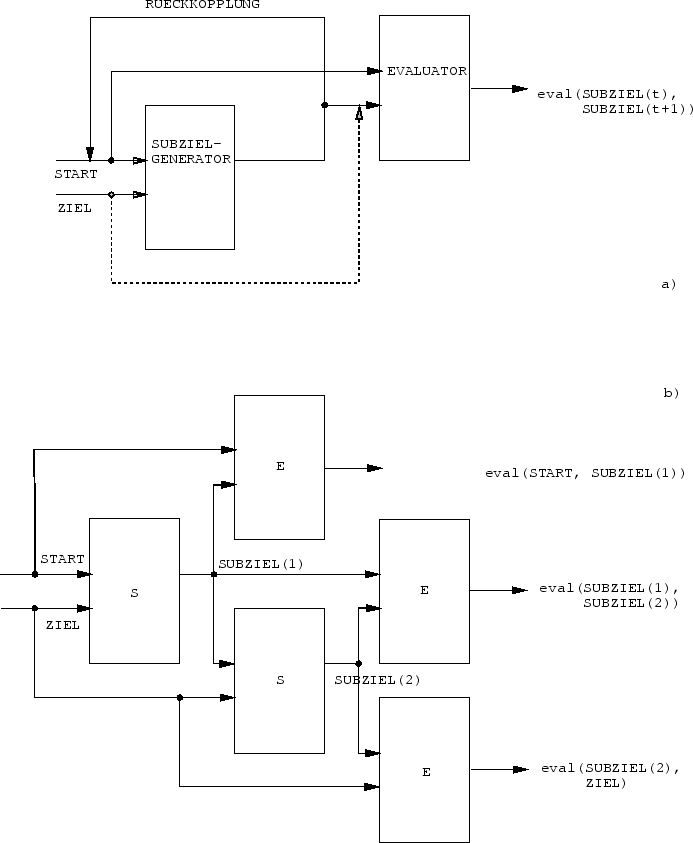

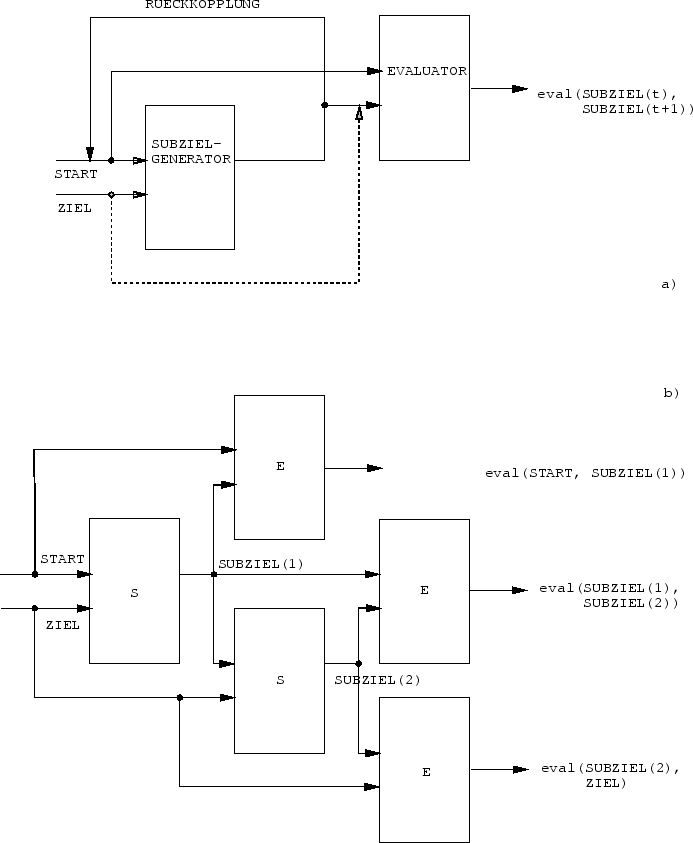

. Die Architektur hat sich aber nun gemäß

Abbildung 4.4a geändert. Abbildung 4.4b zeigt dieselbe Architektur

im zeitlich entfalteten Zustand (nach der Generierung dreier

sukzessiver Subziele).

. Die Architektur hat sich aber nun gemäß

Abbildung 4.4a geändert. Abbildung 4.4b zeigt dieselbe Architektur

im zeitlich entfalteten Zustand (nach der Generierung dreier

sukzessiver Subziele).

Abbildung:

(a) Die Ausgabe des rekurrenten Subzielgenerators  zur Zeit

zur Zeit  wird auf seinen eigenen START-Eingang

rückgekoppelt.

wird auf seinen eigenen START-Eingang

rückgekoppelt.  produziert demnach eine

zeitlich gedehnte Sequenz von Subzielen.

Der Evaluator

produziert demnach eine

zeitlich gedehnte Sequenz von Subzielen.

Der Evaluator  prophezeiht die für zwei

aufeinanderfolgende Subziele zu erwartenden Kosten.

Die gestrichelte

Linie zeigt an, daß

prophezeiht die für zwei

aufeinanderfolgende Subziele zu erwartenden Kosten.

Die gestrichelte

Linie zeigt an, daß  am Ende der Subzielsequenz

das eigentliche ZIEL als Eingabe erhalten muß.

(b) zeigt die rekurrente Architektur (a) im `zeitlich

entfalteten' Zustand (für 2 Subziele).

am Ende der Subzielsequenz

das eigentliche ZIEL als Eingabe erhalten muß.

(b) zeigt die rekurrente Architektur (a) im `zeitlich

entfalteten' Zustand (für 2 Subziele).

|

Nächste Seite: PERFORMANZMASS

Aufwärts: ARCHITEKTUR

Vorherige Seite: SUBZIELARCHITEKTUR 1

Inhalt

Juergen Schmidhuber

2003-02-20

Related links in English: Recurrent networks - Fast weights - Subgoal learning - Reinforcement learning and POMDPs - Unsupervised learning and ICA - Metalearning and learning to learn

Deutsche Heimseite

![]() , verschieden

lange Sequenzen von Subzielen zu produzieren. Dies wird erreicht,

indem man

, verschieden

lange Sequenzen von Subzielen zu produzieren. Dies wird erreicht,

indem man ![]() ' Ausgabe wie folgt auf die eigene Eingabe rückkoppelt:

' Ausgabe wie folgt auf die eigene Eingabe rückkoppelt:

![]() spezifizierten Aufgabe

spezifizierten Aufgabe ![]() ist

ist ![]() ' Eingabevektor

zum 1. Iterationsschritt gleich

' Eingabevektor

zum 1. Iterationsschritt gleich

![]() .

. ![]() ' Ausgabevektor ist

' Ausgabevektor ist ![]() .

.

![]() wird

wird ![]() ' Eingabevektor zu

' Eingabevektor zu

![]() , die Ausgabe wird zu

, die Ausgabe wird zu

![]() . Zur Berechnung der Aktivation

. Zur Berechnung der Aktivation ![]() des

des

![]() -ten Nichteingabeknotens in

-ten Nichteingabeknotens in ![]() zum Iterationsschritt

zum Iterationsschritt ![]() schreiben wir

schreiben wir

![]() zur Berechnung von

zur Berechnung von

![]() , aus

, aus

![]() . Die Architektur hat sich aber nun gemäß

Abbildung 4.4a geändert. Abbildung 4.4b zeigt dieselbe Architektur

im zeitlich entfalteten Zustand (nach der Generierung dreier

sukzessiver Subziele).

. Die Architektur hat sich aber nun gemäß

Abbildung 4.4a geändert. Abbildung 4.4b zeigt dieselbe Architektur

im zeitlich entfalteten Zustand (nach der Generierung dreier

sukzessiver Subziele).