Nächste Seite: ALGORITHMUS

Aufwärts: WELTMODELLBAUER

Vorherige Seite: ZWEI PERFORMANZMASSE

Inhalt

Das Steuernetzwerk

sei (zur vereinfachten Darstellung des Prinzips) ein

konventionelles azyklisches BP-Netzwerk.

Alle Knoten in

sei (zur vereinfachten Darstellung des Prinzips) ein

konventionelles azyklisches BP-Netzwerk.

Alle Knoten in  seien durchnumeriert, die Aktivation

des

seien durchnumeriert, die Aktivation

des  -ten Knotens in Antwort auf

den

-ten Knotens in Antwort auf

den  -ten an der Eingabelage anliegenden Eingabevektor

-ten an der Eingabelage anliegenden Eingabevektor

sei mit

sei mit  bezeichnet,

wobei

bezeichnet,

wobei  , falls

, falls  Eingabeknoten ist.

In der

Eingabeknoten ist.

In der  -ten Lage von

-ten Lage von  (

( )

berechnet sich

)

berechnet sich  wie folgt:

wie folgt:

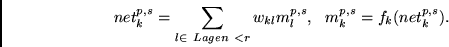

|

(4.1) |

wobei  das Gewicht der gerichteten Verbindung vom

Knoten

das Gewicht der gerichteten Verbindung vom

Knoten  zum Knoten

zum Knoten  darstellt, und

darstellt, und

wieder für eine differenzierbare

Aktivierungsfunktion

steht.

Der Ausgabevektor

der obersten Lage heiße

wieder für eine differenzierbare

Aktivierungsfunktion

steht.

Der Ausgabevektor

der obersten Lage heiße  .

.

Das Weltmodellnetzwerk  sei ebenfalls als

azyklisches BP-Netzwerk implementiert.

sei ebenfalls als

azyklisches BP-Netzwerk implementiert.  's Eingabe ist die Konkatenation

's Eingabe ist die Konkatenation

der Vektoren

der Vektoren

und

und  .

Für

.

Für  's Trainingsphase wird i.a.

's Trainingsphase wird i.a.  gelten,

für

gelten,

für  's Trainingsphase hingegen stets

's Trainingsphase hingegen stets  .

Die Aktivation

des

.

Die Aktivation

des  -ten Knotens von

-ten Knotens von  in Antwort auf

in Antwort auf

wird mit

wird mit

bezeichnet, wobei

bezeichnet, wobei

gleich der

gleich der  -ten Komponente von

-ten Komponente von

ist, falls

ist, falls  Eingabeknoten ist.

In der

Eingabeknoten ist.

In der  -ten Lage von

-ten Lage von  (

( )

berechnet sich

)

berechnet sich

analog zur Aktivationsausbreitung

in

analog zur Aktivationsausbreitung

in  wie folgt:

wie folgt:

|

(4.2) |

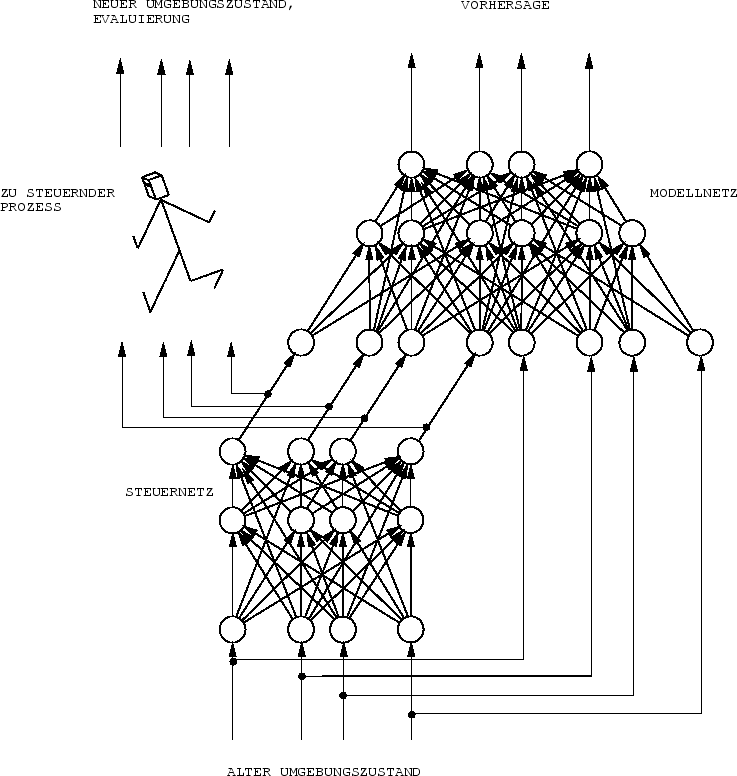

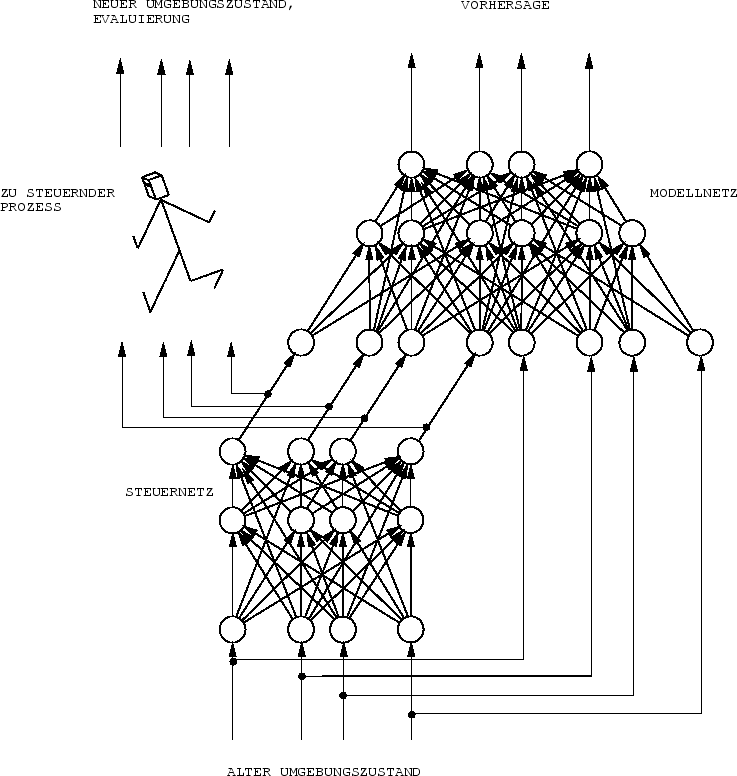

Siehe hierzu Abbildung 4.1.

Abbildung:

Ein Steuernetz reagiert auf den Umgebungszustand mit einem Steuersignal

für einen externen Prozeß. Die Abbildung von Kombinationen von

Zuständen und Aktionen auf Effekte in der Umgebung wird durch

ein zweites adaptives `Modellnetzwerk' modelliert.

Letzteres dient auch zur Gradientenberechnung für das Steuernetz.

|

Nächste Seite: ALGORITHMUS

Aufwärts: WELTMODELLBAUER

Vorherige Seite: ZWEI PERFORMANZMASSE

Inhalt

Juergen Schmidhuber

2003-02-20

Related links in English: Recurrent networks - Fast weights - Subgoal learning - Reinforcement learning and POMDPs - Unsupervised learning and ICA - Metalearning and learning to learn

Deutsche Heimseite

![]() sei (zur vereinfachten Darstellung des Prinzips) ein

konventionelles azyklisches BP-Netzwerk.

Alle Knoten in

sei (zur vereinfachten Darstellung des Prinzips) ein

konventionelles azyklisches BP-Netzwerk.

Alle Knoten in ![]() seien durchnumeriert, die Aktivation

des

seien durchnumeriert, die Aktivation

des ![]() -ten Knotens in Antwort auf

den

-ten Knotens in Antwort auf

den ![]() -ten an der Eingabelage anliegenden Eingabevektor

-ten an der Eingabelage anliegenden Eingabevektor

![]() sei mit

sei mit ![]() bezeichnet,

wobei

bezeichnet,

wobei ![]() , falls

, falls ![]() Eingabeknoten ist.

In der

Eingabeknoten ist.

In der ![]() -ten Lage von

-ten Lage von ![]() (

(![]() )

berechnet sich

)

berechnet sich ![]() wie folgt:

wie folgt:

![]() sei ebenfalls als

azyklisches BP-Netzwerk implementiert.

sei ebenfalls als

azyklisches BP-Netzwerk implementiert. ![]() 's Eingabe ist die Konkatenation

's Eingabe ist die Konkatenation

![]() der Vektoren

der Vektoren

![]() und

und ![]() .

Für

.

Für ![]() 's Trainingsphase wird i.a.

's Trainingsphase wird i.a. ![]() gelten,

für

gelten,

für ![]() 's Trainingsphase hingegen stets

's Trainingsphase hingegen stets ![]() .

Die Aktivation

des

.

Die Aktivation

des ![]() -ten Knotens von

-ten Knotens von ![]() in Antwort auf

in Antwort auf

![]() wird mit

wird mit

![]() bezeichnet, wobei

bezeichnet, wobei

![]() gleich der

gleich der ![]() -ten Komponente von

-ten Komponente von

![]() ist, falls

ist, falls ![]() Eingabeknoten ist.

In der

Eingabeknoten ist.

In der ![]() -ten Lage von

-ten Lage von ![]() (

(![]() )

berechnet sich

)

berechnet sich

![]() analog zur Aktivationsausbreitung

in

analog zur Aktivationsausbreitung

in ![]() wie folgt:

wie folgt: